预训练的大语言模型(LLM)改变了自然语言处理 (NLP) 领域的游戏规则,使得在资源有限的各种语言任务上取得最先进的结果成为可能。 它已经接受了大量数据的训练,可用于各种自然语言处理任务。 然而,预先训练的模型可能并不总是在特定任务或领域上表现最佳,这就是微调发挥作用的地方。

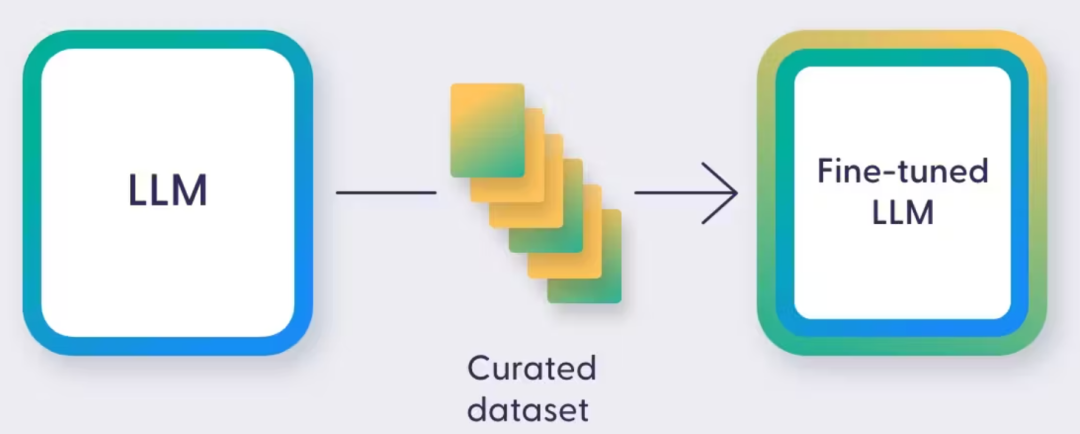

微调(Fine tune)通常是必要的,因为预训练模型是根据一般语言理解进行训练的,并且微调过程使模型适应特定的任务或领域。

像医疗问答聊天机器人这样的例子。

该聊天机器人的目标是分析用户描述的症状,并提供潜在的诊断或建议以进行进一步的测试或专家咨询。

然而,为了构建有效的医疗聊天机器人,我们需要进行微调LLM大模型,以确保其在医疗保健等高度关键领域的准确性和安全性。

因此,微调需要涉及更多的知识和技能:

- 特定领域的知识:例如医学领域有自己独特的术语和语言约定。 为了充分掌握精确诊断所需的复杂医学术语,微调是必须的。

- 情境理解:根据患者记录和相关医学文献对大模型进行微调,有助于将症状置于情境中并做出更明智的预测。

- 安全和道德:微调使聊天机器人能够更加谨慎地提供诊断和建议

- 减少偏见:根据多样化且具有代表性的医疗数据集对大模型进行微调,有助于减少偏见并促进公平公正的医疗保健建议。

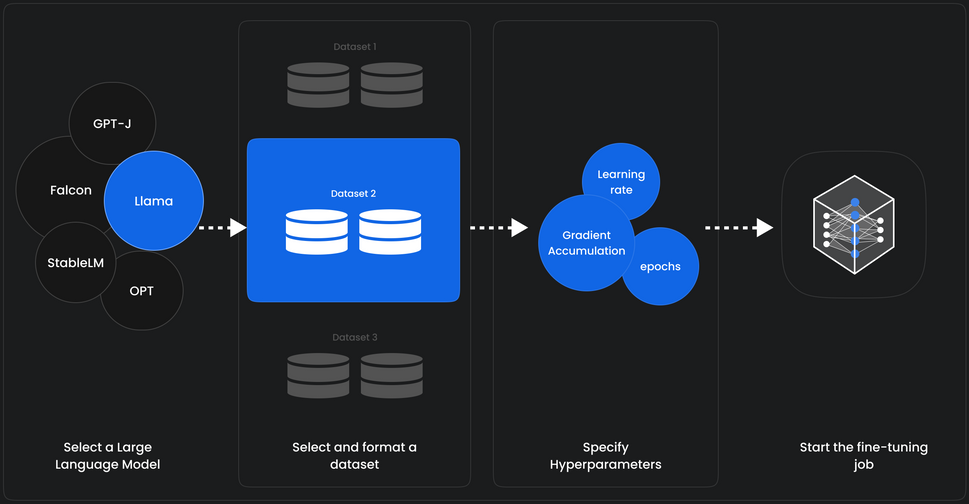

微调涉及调整各种超参数,例如学习率、批量大小和训练周期数,以优化模型在特定任务上的性能。 整体微调流程如下图所示:

欢迎联络我们了解更多关于企业大模型微调的内容。